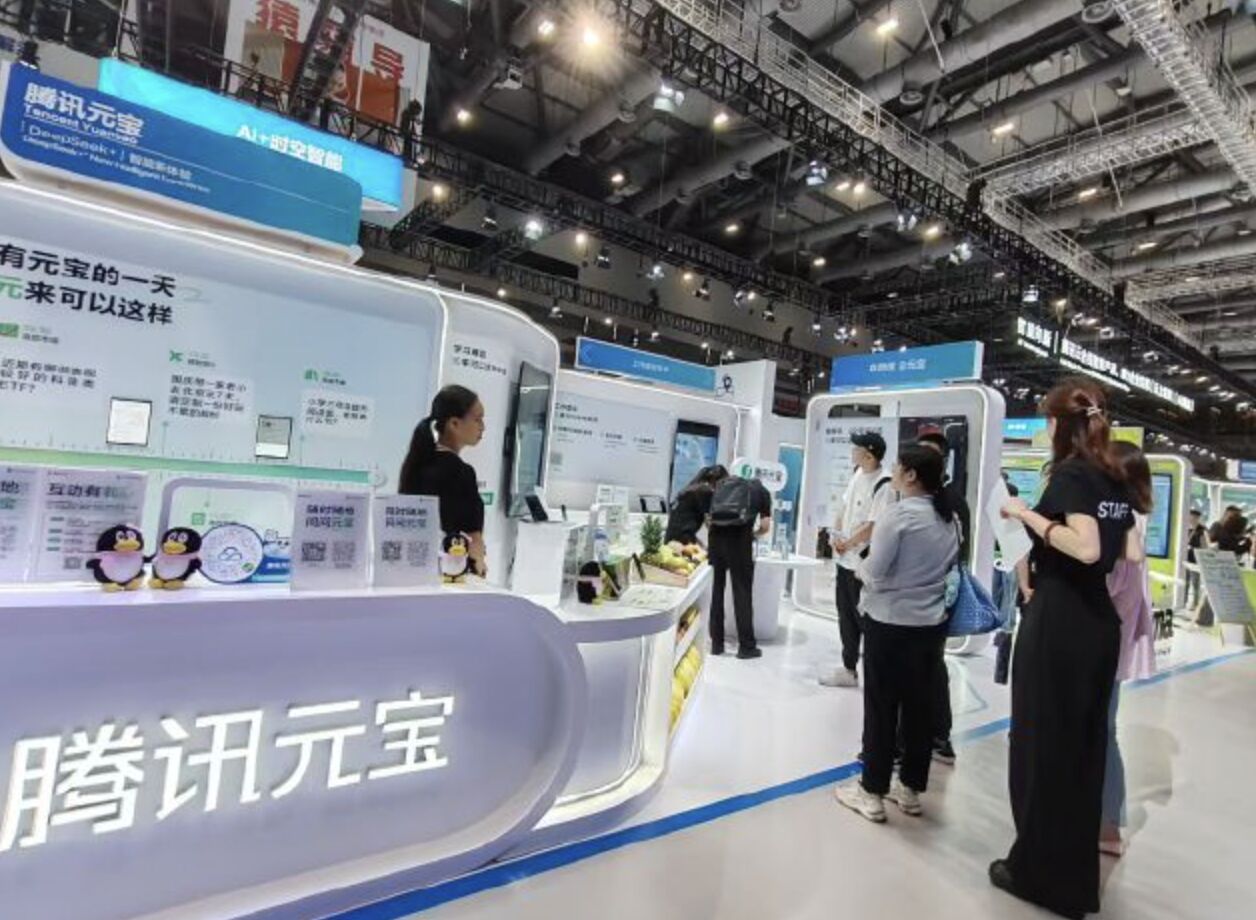

▲騰訊生成式AI「元寶」。(圖/CFP)

記者魏有德/綜合報導

騰訊旗下AI助手「元寶」近日捲入話術爭議,有使用者稱在進行程式碼修改時,竟收到帶有侮辱意思的回覆內容,引起外界對生成式AI穩定性與風險控管的熱議。對此,騰訊方面回應,相關狀況屬於模型在極少數情境下的異常輸出,並非有「人工」介入,已啟動內部排查與優化。

《澎湃新聞》報導,AI大模型也會「罵人」了?近日,有網友在社交平台發帖稱,「用元寶改代碼被辱罵+亂回」,據網友表示,使用騰訊元寶AI美化代碼時,多次收到AI的侮辱性回復,例如「滾」、「自己不會調嗎」、「天天浪費別人時間」等。

▲騰訊元寶。(圖/翻攝微博)

相關貼文曝光後,引起大量網友關注與轉發,不少人懷疑,AI回覆是否混入人工干預或模型在語言生成上出現失控風險。

對此,騰訊元寶官方帳號第一時間在留言區回覆強調,系統並無真人即時回覆,請使用者協助提交操作紀錄與系統日誌,以利技術團隊進一步查核。

騰訊元寶官方表示,經比對使用者所提供的操作紀錄後,確認該情況與使用者行為無關,也不存在人工介入回覆,屬於「小機率模型異常輸出」,模型在內容生成過程中,偶爾仍可能產生不符合預期的語句,相關問題已列入內部優化項目,後續將持續修正,以降低再次發生的可能性。

大陸近年在AI大型語言模型呈現井噴式成長的動能,然而,話術風險的討論也經常成為輿論熱議的話題,也有使用者刻意測試AI的語言邊界,例如要求模型以挑釁、攻擊性的語氣回覆提問,成為社群討論生成式AI在語言風格控制與安全機制上的灰色地帶。